编译/前方智能

Meta 的研究团队近日发布了一项重要研究,推出了名为 MobileLLM 的新型语言模型。这项技术旨在为智能手机等资源受限设备创建高效的 AI 模型,挑战了传统认为高效语言模型必须庞大的观念。

图源:Meta

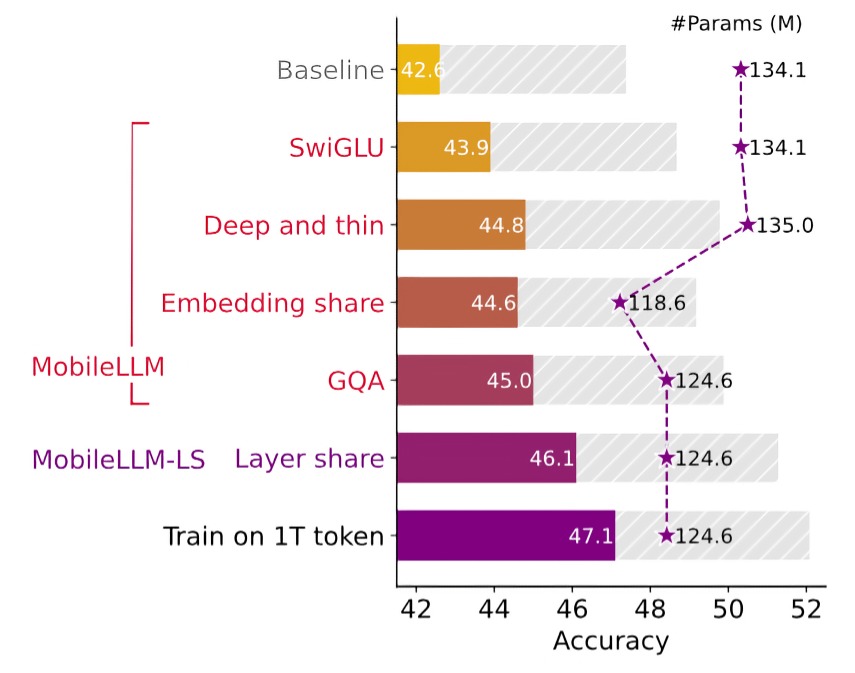

MobileLLM 的核心创新在于优化少于 10 亿参数的模型,相比 GPT-4 等超大模型,规模大幅缩小。研究团队采用了多项创新技术,包括优先考虑模型深度、实施嵌入共享和分组查询注意力机制,以及使用新型即时分块权重共享技术。

测试结果显示,MobileLLM 在常见基准任务上的表现比同等规模模型提高了 2.7% 至 4.3%。特别值得注意的是,仅有 3.5 亿参数的 MobileLLM 版本在某些 API 调用任务上展现出与 70 亿参数 LLaMA-2 模型相当的准确性。

Meta 首席 AI 科学家 Yann LeCun 强调了这项研究的重要性。虽然 MobileLLM 尚未公开使用,但 Meta 已开源预训练代码,为未来研究奠定基础。这一发展预示着更高效、更易获得的 AI 技术即将到来,有望在个人设备上实现更先进的 AI 功能,为用户带来全新的应用体验。

来源:Meta