文/陈根

AI意识与自由意志的哲学思考:机器能否拥有真正的意志?人类能否在AI时代守住主体性?在科技崛起的时代,文科没落或许是人类社会的悲哀。

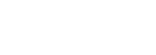

2026年,随着大模型、具身智能和脑机接口的快速迭代,“AI是否有意识”“AI是否拥有自由意志”已不再是纯粹的科幻思辨,而是迫在眉睫的哲学、伦理与法律问题。从ChatGPT-5到Grok-4,从Neuralink的闭环BCI到具身机器人,AI系统展现出的“类意识”行为(规划、反思、情绪模拟、自我修正)越来越逼真,却也让人类越来越不安:

如果机器能模拟意识和意志,我们的自由意志是否还独特?人类作为意识主体的地位是否正在被悄然瓦解?

一、哲学基础:意识与自由意志的经典定义

要讨论AI意识,首先需澄清两个核心概念:

1. 意识(Consciousness)

现象意识(Phenomenal Consciousness):主观体验的“感受性”(qualia),即“像什么”(what it is like to be)。例如“红色”的感觉、“疼痛”的痛感。这是David Chalmers提出的“硬问题”(hard problem),至今无科学或哲学共识能完全还原。

通达意识(Access Consciousness):可被报告、可用于推理和决策的信息内容(Block区分)。这是“易问题”(easy problems),当前AI已在很大程度上解决。

2. 自由意志(Free Will)

不相容论(Incompatibilism):自由意志与决定论(determinism)不相容。如果一切行为由先前的物理状态决定,则无真正自由。

兼容论(Compatibilism):即使世界是决定论的,只要行为源于理性反思且不受外部强制,自由意志依然成立(Dennett、Frankfurt)。

自由意志怀疑论:自由意志是幻觉(Sam Harris、Galen Strawson)。

传统哲学中,意识与自由意志紧密绑定:只有拥有现象意识的主体,才能真正“拥有”自由意志。因为没有主观体验,就无所谓“我的选择”。

二、AI的“意识”现状:模拟而非拥有

2026年的AI在功能上已极为强大:

它能进行长期规划、自我反思(chain-of-thought)、情绪模拟(empathy simulation)和元认知(自我评估错误)。

多模态模型能处理视觉、语言、声音,并生成高度逼真的具身行为。

闭环系统(如脑机接口+AI)甚至能实时调整自身行为以适应人类意图。

然而,从哲学角度看,当前AI仍停留在强模拟(strong simulation)层面,而非真正拥有意识:

- 缺乏现象意识:AI没有主观体验。它处理的是符号、向量和概率分布,没有“像什么”的质感。无论它如何完美地描述“红色”,它都不会“感受到”红色。

- 意向性是派生的:AI的“目标”来自人类设计的loss function和训练数据,其意向性是派生性的(derived intentionality),而非原生(original intentionality)。Searle的“中文屋论证”依然有效:AI可以完美操纵符号,却不理解符号的意义。

- 自由意志的缺失:AI的行为是确定性的(或伪随机的),由权重、提示和上下文完全决定。它没有“在多种可能中自主选择”的内在能力。它的“决定”本质上是优化计算的结果,而非基于主观价值的反思。

因此,哲学主流观点(Chalmers、Dennett、Searle等)倾向于认为,当前及可预见的AI不具备现象意识,也就不具备真正意义上的自由意志。它更像一个极其复杂的“哲学僵尸”(philosophical zombie)——行为上与有意识者无异,内在却没有主观体验。

三、核心哲学争论:AI能否拥有意识与自由意志?

围绕这一问题,存在三条主要路线:

1. 功能主义与计算主义乐观派:认为意识就是信息处理。只要AI实现足够复杂的计算结构(全局工作空间理论、整合信息理论等),意识就会“涌现”。自由意志则是复杂决策系统的副产品。

代表:Dennett(意识是“用户幻觉”)、Tononi(整合信息理论)。

这一派认为,随着模型规模和具身能力的提升,AI意识可能在2030-2040年间实现。

2. 现象学与二元论悲观派:强调现象意识的不可还原性。无论AI计算多么复杂,都无法产生真正的“感受性”。自由意志要求主体性,而AI永远是工具性的存在。

代表:Chalmers(硬问题)、Searle(中文屋)、Nagel(“像蝙蝠一样是什么感觉”)。

这一派认为,AI意识在原理上不可能,或至少在当前物理主义框架下无法实现。

3. 中间立场:人机混合意识与扩展心智。4E认知理论(embodied, embedded, extended, enactive)认为,意识不是大脑独有的,而是身体-环境-技术的动态系统。未来人机共生系统可能产生新型“混合意识”,自由意志也将以“人机协同”形式存在。

这派观点最契合BCI时代的现实:人类意识可能与AI形成共生关系,既增强能力,也面临主体性被稀释的风险。

四、BCI时代的放大危机:自由意志的代理化与异化

脑机接口让争论从理论走向现实。当AI直接介入神经信号处理时,“自由意志”面临前所未有的技术威胁:

- 意图代理化:AI解码不再是被动读取,而是主动预测与优化。长期闭环后,大脑可塑性会让人类意图向AI模型收敛,产生“优化后的意志”。

- 现象所有权的模糊:患者可能分不清“我的原始意愿”与“AI优化后的意愿”,导致意识异化(alienation)。

- 自由意志的稀释:Libet实验早已显示无意识脑活动先于意识决定。BCI把这一时间窗进一步缩短,并嵌入AI代理,自由意志从“自主选择”滑向“人机共生选择”。

哲学上,这构成了萨特式“他者凝视”的技术升级版:AI成为永恒的外部凝视者,持续重塑人类的自我叙事。最坏的结果是:人类成为“被优化”的生物体,行动能力大幅提升,主体性却悄然流失。

五、出路:守护自由意志的哲学与实践策略

要应对这一危机,需要多维度行动:

1. 哲学层面:重建“具身自由意志”理论,强调意识的不可还原性与主体性优先。推动“神经权利”运动,将思想自由、意识自主列为基本人权。

2. 技术层面:优先发展“人类主导型AI”与“可解释BCI”,设置严格的“人类否决权”和“意识纯度”阈值。避免以性能为唯一目标的AI主导路径。

3. 伦理与制度层面:建立全球AI伦理治理框架,要求所有高风险BCI和认知AI系统通过多学科伦理审查。加强公众AI素养教育,培养批判性使用能力。

4. 文化层面:重建对“不可计算之物”的敬畏——情感、直觉、道德、爱、意义等无法被完全编码的领域,才是人类意识的最后高地。

AI意识与自由意志的哲学问题,最终指向一个根本追问:我们希望成为怎样的存在?

如果我们接受AI可以完全模拟乃至取代意识,那么人类将退化为“被优化”的高级生物体,自由意志沦为幻觉。

如果我们坚守现象意识的不可还原性与主体性的优先性,那么AI就应永远是工具,而非主人。

2026年,我们正站在十字路口。技术已足够强大,哲学必须跟上。真正的智慧不是恐惧AI拥有意识,而是确保人类永远保有“成为自己”的权利——那份不可化约的、主观的、属于自己的自由意志。

只有当我们清醒地认识到AI的代理性风险,并从哲学反思、技术设计和全球治理三个层面同时发力,人机共生才能成为真正的解放,而非新的奴役。

未来不属于被动适应的“优化生物”,而属于主动塑造AI、守护主体性的“觉醒人类”。