文/VR陀螺 Wickey

Google I/O 开发者大会,是科技行业洞察 Google 最新技术布局的重要窗口。

作为全球开发者和行业观察者瞩目的盛会,Google I/O 2026 将于当地时间 5 月 19 日至 20 日在加州山景城线下揭幕并全球直播,此次大会聚焦 AI 驱动的系统级操作与融合,这同时也为 XR 领域带来关键启示。

自 2008 年首届 Google I/O 开发者大会举办以来,Google I/O 已由工程师和开发者的技术交流与聚会,演变成了涵盖软件开发、人工智能、云计算、移动生态及硬件创新多元融合的科技盛会。大会始终践行“input/output”的理念在开放中创新。

今年大会不仅是 Android 系统的技术更新发布平台,也是 Google XR 生态与 AI 硬件的重要展示舞台。行业观察者普遍认为,2026 年的 I/O 将标志着 Google 在沉浸式计算领域迈入新阶段。

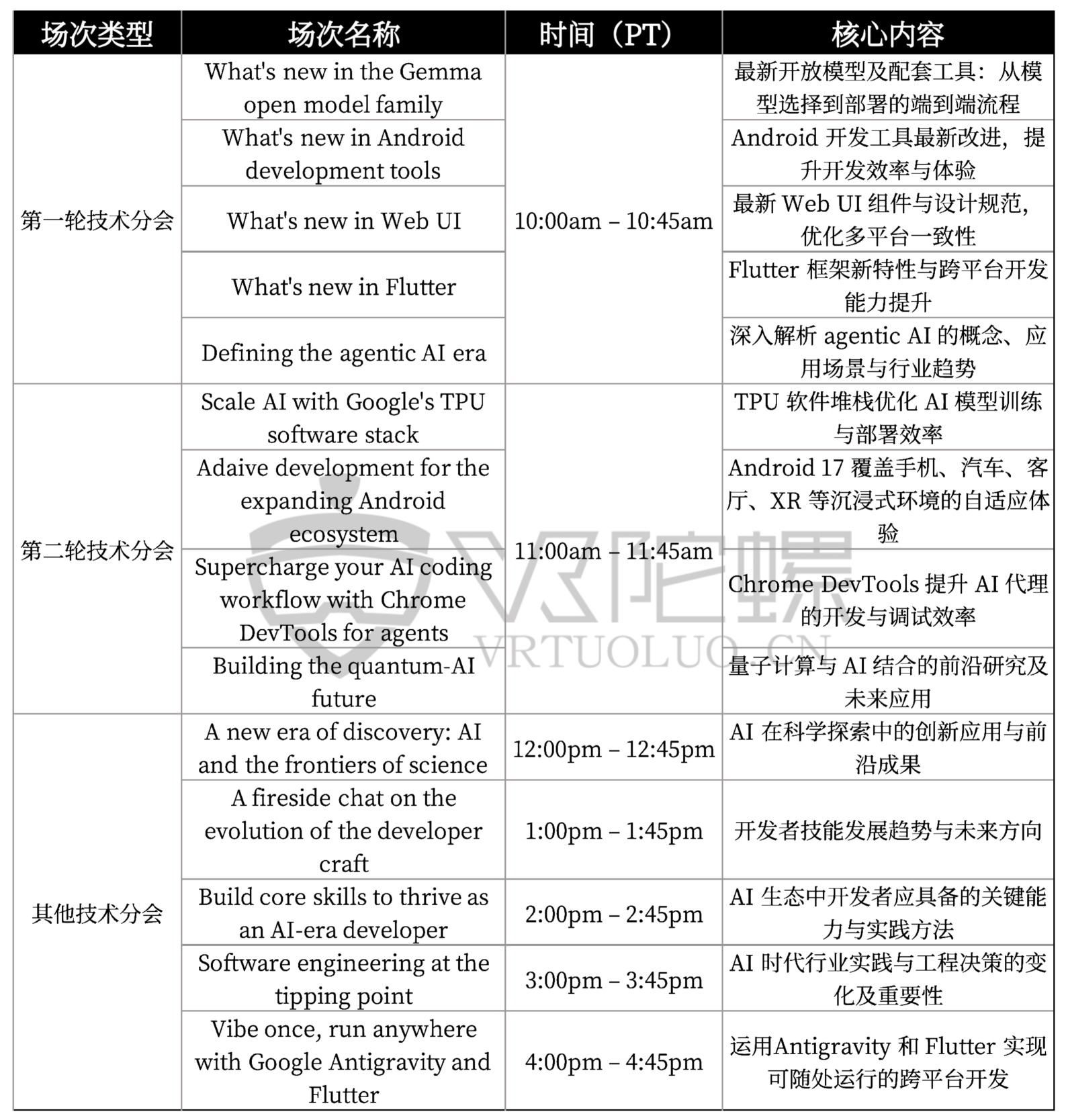

Google I/O 2026 议程

2026 年恰逢 AI 高速发展之年,各大公司抢占高地,Google I/O 2026 又将会交出怎样的答卷?根据 Google 官方公布的议程预测,AI 是此次大会的绝对主线。

会议为期两天,在 Google 的官方 YouTube 频道和 I/O 官网 全程直播。首日由 Google 主题演讲和开发者主题演讲拉开序幕,随后进入密集的分会场和实验室讨论议程。

以下整理了官方发布的活动议程:

DAY 1(May 19)

.png)

DAY 2(May 20)

Google I/O 2026 看点

Android XR

在 5 月 12 日 Android Show 的新闻发布会上,Google 表示 Android XR Glasses 将在 5 月 19 日开幕的年度开发者大会I/O上亮相。Google 已经通过与三星、XREAL、Warby Parker 和 Gentle Monster 的合作,为其新款 XR 眼镜铺设好未来发展的道路,预计这些公司会将把搭载 Android XR 技术的穿戴设备推向市场。

Android XR 在底层技术上的革新,是对 Android 系统从架构到显示的一次重新构建,旨在为空间计算时代打造一个开放且性能强大的平台。将 AI 深度集成到 3D 物理世界的计算中,从根本上保证性能、流畅度和生态开放性。

自 Android XR 在 Google I/O 2025 中首次亮相以来,行业普遍认为 Google 正在重点开发一种全新的 “AI+XR” 的设备逻辑,目前 AI 的主要操作窗口是手机或电脑,而随着 XR 技术的进步以及智能眼镜的普及,智能眼镜将成为 AI 的新入口。

据推测,传统的 AI 使用方式正在被逐步重构,从需要主动的操作的手机、电脑转向无感化的使用智能眼镜或 MR 头显设备。未来用户或将不再需要主动打开应用,而是通过眼镜这一始终在线、实时感知环境的设备,实现与 AI 更高效便捷的自然交互。

近期 Google CEO 与高管在采访中多次强调,未来 AI 不只是聊天机器人,而是可以“理解现实世界并主动行动”的 Agent 。这意味着 Android XR 很可能会成为 Google 下一代 AI Agent 的物理载体。

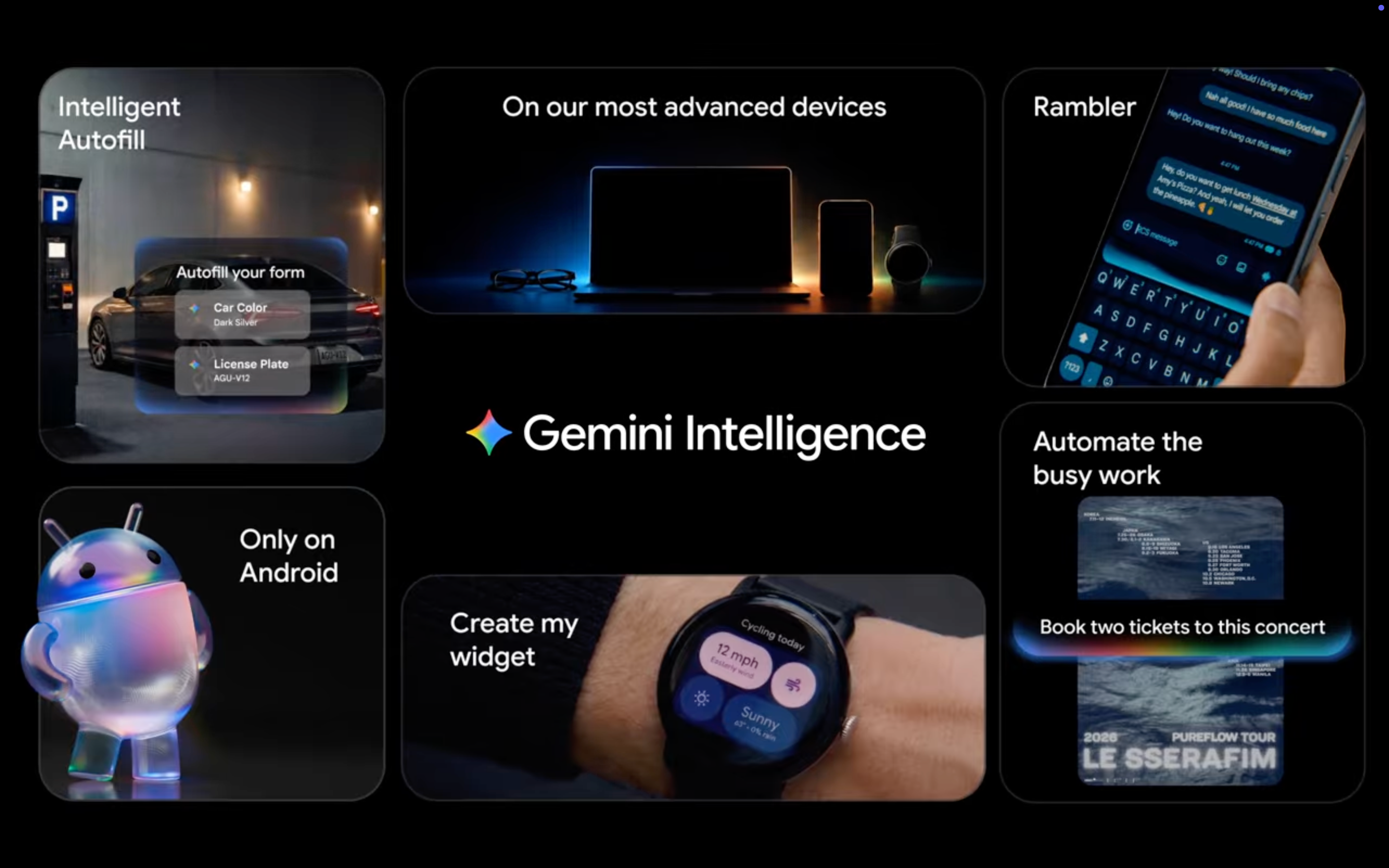

Gemini Intelligence

尽管 Google 尚未正式公布 Gemini Intelligence 具体版本号,但从 Google I/O 2026 的官方预热信息与开发者议程来看,新一代 Gemini(业内普遍称之为 Gemini 4.0) 有可能成为本届大会最具颠覆性的技术主线,并承担 Google AI 体系从工具向系统层面的智能体跃迁。

值得注意的是,Google 正在持续推动 AI 升级为智能操作系统。以 Gemini 驱动的官宣日期谜题小游戏中,AI 分别担任了“舞台设计师”、“创意助手”、“程序工程师”等角色,这提前释放出 Gemini 的在底层架构与交互能力的升级。

更重要的是,Google 正在将 AI 与空间计算体系硬件深度绑定,使其不再停留在屏幕内部,而是逐步进入现实世界。在这一框架下,AI 不只是回答问题,而是参与构建一个主动、连续、可感知的沉浸式交互环境。

这不仅将 XR 设备与生俱来的外界感知能力推上全新台阶,也使其与 AI 的融合愈发紧密。对于未来会迸发出什么火花,我们拭目以待。

Agentic AI

Agentic AI 是当前人工智能发展的下一阶段,其核心在于将单纯生成内容的聊天机器变为可自主决策与执行的代理工具。相比传统生成式 AI 主要承担信息输出角色,Agentic AI 能够基于目标理解环境、规划步骤,并主动完成复杂流程,从而在更大程度上替代或辅助人类进行工作流执行。

在过去几年,Google 在文字、图像、视频、音频等领域的 AI 技术上均有建树,而此次 Google I/O 2026 有可能是 Agentic AI 的首次全面展示。业内预测,这次发布不仅会在软件层面展示其能力,还可能结合 Android XR 设备,实现 Agentic AI 在现实环境中的沉浸式交互。

Android 17

众所周知,Android 是目前与 Gemini 生态适配最为紧密的操作系统之一。此前 Google 已于今年 2 月发布 Android 17 的首个开发者预览版本(Developer Preview)。经过数月的开发者测试与系统级优化,Android 17 的正式版本预计将在今年夏季或第三季度正式发布,并大概率与下一代 Pixel 设备的发布周期同步亮相。

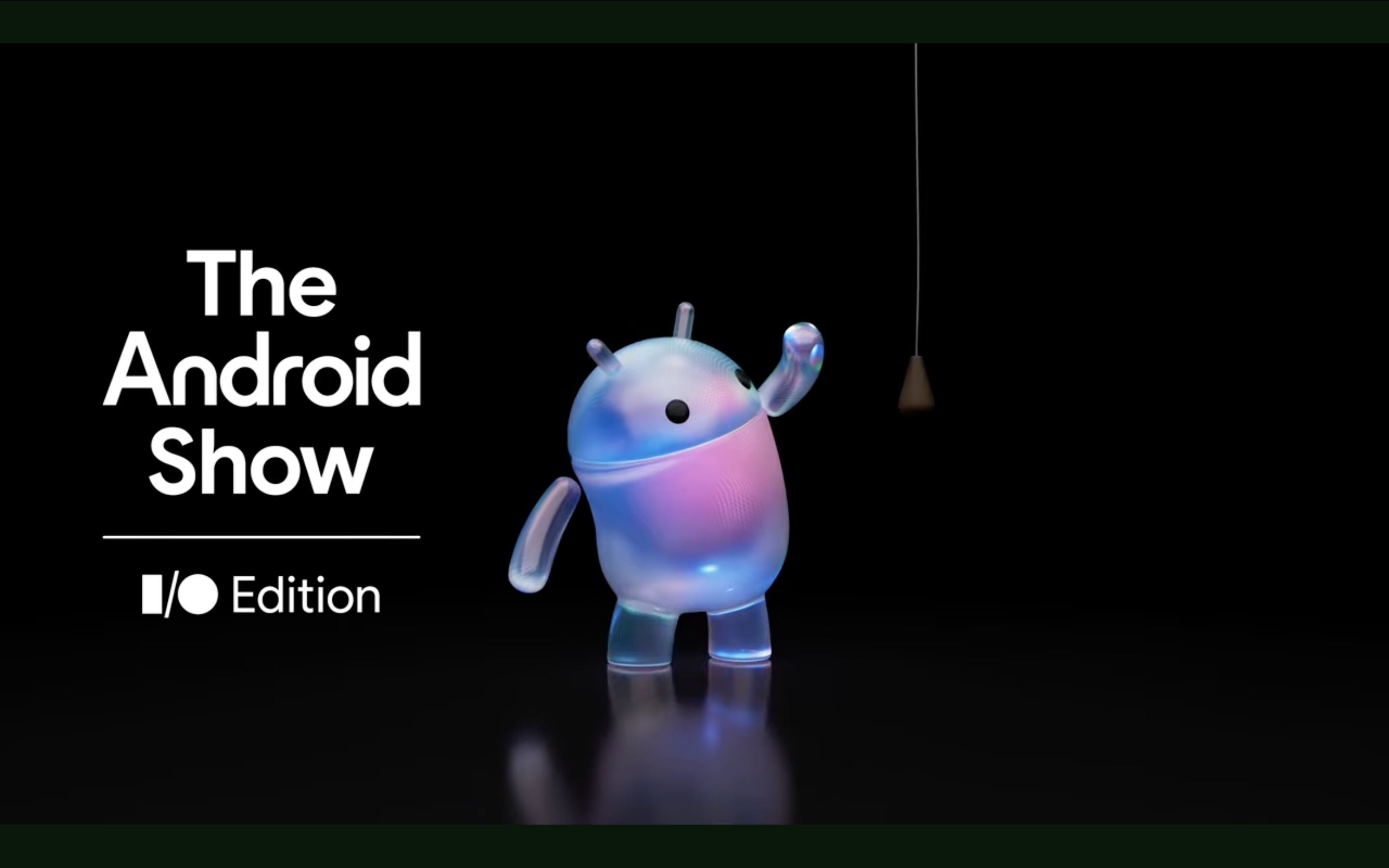

此次 Google I/O 2026 于 5 月 12 日提前发布的 “The Android Show: I/O Edition”,也在一定程度上为大会正式内容进行了预热。在官方视频与演示内容中可以观察到 Android 正在加速构建一个“多设备互联”的统一框架。使手机、平板、可穿戴设备以及 XR 终端之间的交互边界进一步模糊。Gemini 被更深度嵌入系统层级,开始以“常驻式 agent ”的形式存在于设备中,而不仅仅作为应用级助手出现。

Android XR 的生态首秀与硬件预览

在 AI 贯穿全场的主旋律下,Google I/O 2026 将为 XR 行业注入了一剂强心针。当下 Apple Vision Pro 产品团队调整频繁、Meta 大幅削减 VR 投入,市场正从头显转向智能眼镜。但 Google 携 Android XR 生态强势登场,以“安卓式”联盟联合三星、高通及多家眼镜品牌,Google 试图将 XR 竞赛从硬件竞赛转向生态战争,为行业开辟一条全新路径。

- Android XR 智能眼镜将在 I/O 2026 正式亮相

Google 已确认将在本届 I/O 上首次集中展示 Android XR 智能眼镜生态。此前 Google 已与 Samsung、XREAL、Warby Parker、Gentle Monster 等厂商建立合作,预计未来一年内会陆续推出搭载 Android XR 的消费级设备。相比苹果封闭式硬件路线,Google 更希望复制 Android 手机时代的开放生态模式。

- Google 正在构建“AI + XR”双形态产品路线

从目前曝光的信息来看,Android XR 并非面向单一设备,而是覆盖两种不同方向。

一类是偏轻量化的 AI 智能眼镜,以语音、摄像头与 Gemini 实时交互为核心;另一类则是具备完整空间显示能力的 XR/MR 设备,用于生产力、沉浸式内容与空间计算。

Google 显然意识到,“全天佩戴”比“完全沉浸”更接近消费级市场。

- Android XR 的真正目标是让 AI 离开屏幕

从目前所有公开信息来看,Google 的 XR 战略已经明显不同于上一代的逻辑。其核心不再是“构建完全的虚拟世界”,而是让 AI 进入现实世界。 Android XR 当前重点强调:

-

- 第一人称计算(Egocentric Computing)

- 实时视觉 AI(Live Vision AI)

- 环境语义理解(Scene Understanding)

- 主动式 AI Agent

- 多模态交互(语音/视觉/手势) 这意味着 Google 正试图让智能眼镜成为 AI 的下一代入口,让 AI 从手机屏幕中解放出来,成为持续存在于用户视野范围内的 AI 助手。

- Android 17 与 XR 系统融合

Android 17 的演进方向,正在为 Android XR 提供底层系统级支撑。相比以往版本更偏向移动设备优化,Android 17 明显呈现出“多设备互联”的架构趋势。

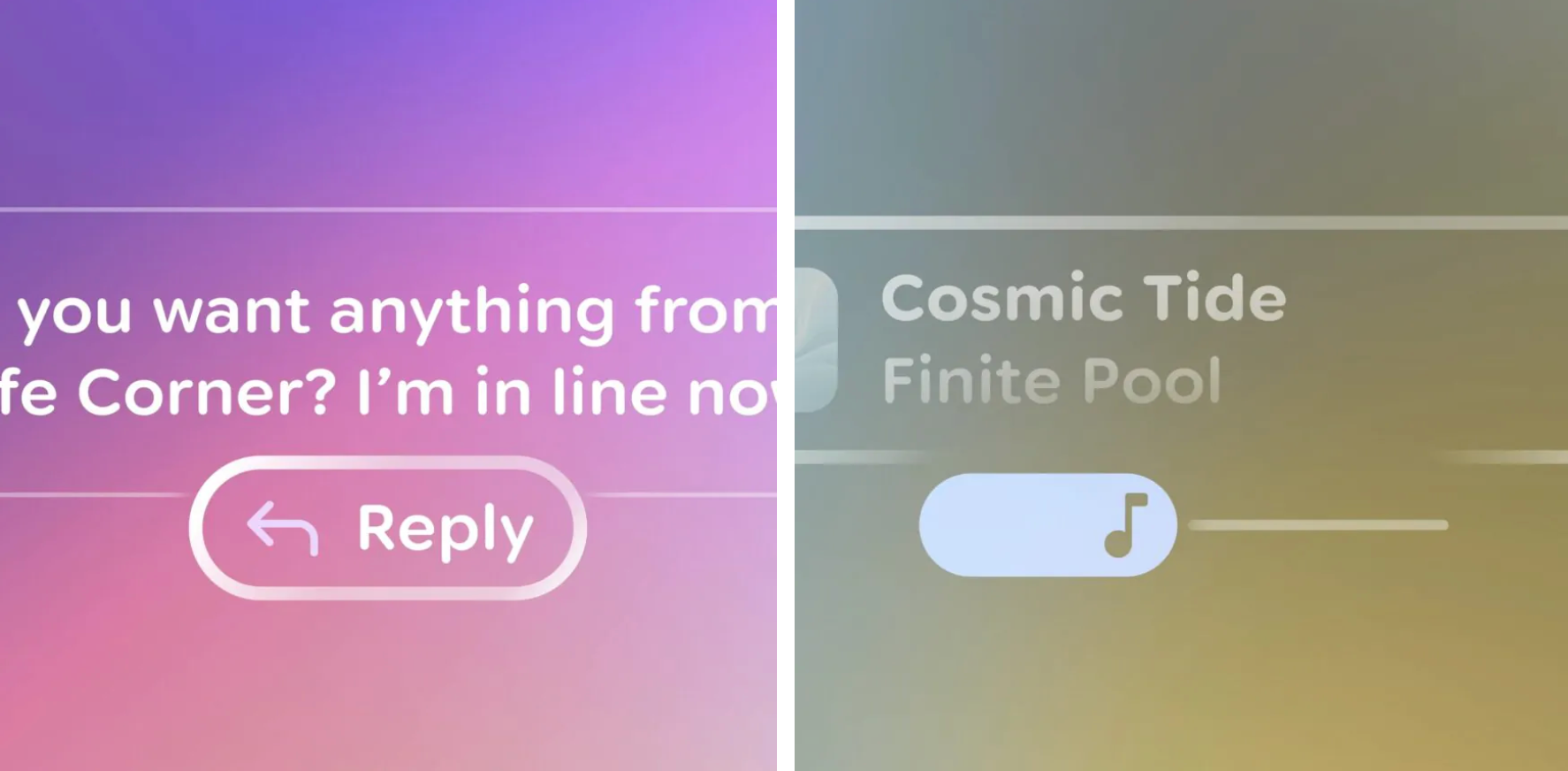

在 “The Android Show: I/O Edition” 视频中呈现的 UI 交互风格也释放出一个重要信号,Android 正在为 Android XR 生态做系统级铺垫。

例如更强调浮动式信息层、环境感知型提示,以及跨屏连续操作逻辑,这些能力都为未来在 AI 眼镜、AR 设备与 MR 头显中的运行形态提供了基础。

- 开发者工具与平台全面就绪

目前 Google 已推出 Android XR SDK 开发者预览版 3,并发布了专为透明镜片设计的全新 UI 工具库——“Glimmer”。这些工具旨在降低开发门槛,帮助开发者轻松构建在智能眼镜上体验友好的应用,预计在消费者产品问世前,SDK 和硬件开发套件就会提前到位,为生态繁荣做好准备。而此次大会上也必然会有更多 Android XR 系统开发的配套支持发布。

- 三星 Galaxy XR 与“Galaxy Glasses”或将首次公开展示

据外媒爆料,Google I/O 2026 上三星很可能首次展示其 Android XR 智能眼镜产品。根据近期泄露信息,这款代号 “Jinju” 的设备将采用类似 Meta Ray-Ban 的轻量化设计,并搭载 Qualcomm Snapdragon AR1 芯片、12MP 摄像头与定向扬声器系统,整体重量约 50g。相比传统头显,这类产品明显更强调日常佩戴属性。

就目前整体趋势来看,Google I/O 2026 所释放出的信号已经非常清晰,XR 的下一阶段不再由显示技术定义,而是由 AI 是否能与之适配决定。

过去十年,XR 的核心竞争围绕分辨率、视场角与显示能力展开;但在 AI 介入之后,竞争焦点正在发生根本转移,谁能提供更强的 AI 理解能力、更完整的生态系统,以及更自然的人机交互方式,才真正决定未来市场格局。

在这一背景下,Android XR 的战略意义不止于它是否构建了一款成功的硬件,而在于 Google 是否成功把 XR 纳入其“Gemini Intelligence 生态系统”中。换句话说,Google 正在尝试做的并不是“进入 XR 市场”,而是想通过 AI 重新定义 XR 本身。