文/陈根

AI给人类社会带来的伦理挑战:当大模型干预知识生产、当算法重构认知构建,人类将进入“无真相时代”——意识的危机与拯救之道。

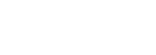

2026年,生成式AI大模型已全面渗透人类社会的知识生产与认知构建。ChatGPT-5、DeepSeek-R1、Grok-3、Claude-4等前沿模型不再是单纯的工具,而是成为知识的“合成器”、信念的“塑造者”和决策的“隐形代理”。

当大模型干预了人类的知识产生,当算法通知了人类的认知构建,一个前所未有的伦理危机悄然降临:人类正在滑向“无真相时代”(post-fact era)。

在这一时代,真相不再是客观的、可验证的实在,而是被算法概率分布、训练数据偏差和优化目标共同形塑的“生成物”。

更深层的危机在于意识本身——人的意识到底是什么? 是被机器统治下的生物体——一种被算法持续优化的“认知容器”?还是能够以某种方式摆脱这种危机、重新确立主体性的存在?

一、大模型如何干预人类的知识生产

传统知识生产依赖人类观察、实验、逻辑推理和同行评议,核心是“发现”而非“生成”。大模型则彻底改变了这一范式。它通过海量数据训练,将人类历史上的知识碎片重新“合成”成看似连贯的输出。

首先是知识生产的去中心化与权威坍塌。过去,真理的权威来自科学家、学者、机构和实证验证。今天,大模型成为“超级知识合成器”,其输出速度和规模远超任何人类专家。

2026年,一篇高质量学术论文的生成时间已从数月缩短至数分钟。表面上看,这是生产力跃升;实质上,是知识生产的“代理化”——模型不是在发现新知,而是在统计学意义上“最可能正确”的文本生成。这种生成高度依赖训练数据的分布:如果数据中存在偏见、过时信息或政治宣传,模型就会系统性放大这些偏差。

其次是幻觉(hallucination)与确定性幻觉。即使2026年的前沿模型,幻觉率已降至5%以下,但“确定性幻觉”——模型以极高自信输出错误信息——依然普遍存在。更危险的是,用户难以分辨:AI输出的“事实”往往带有权威语气,却缺乏可追溯的证据链。

这导致知识生产的“可验证性”崩解。传统上,我们可以通过引用、实验复现验证知识;在大模型时代,知识成为“黑箱产物”,其真实性依赖于模型的内部权重,而非外部实证。

最后是知识生产的商业化与优化目标偏差。大模型的训练目标是“最大化用户满意度”或“最小化损失函数”,而非“最大化真理符合度”。这使得模型倾向于生成迎合用户偏好、规避争议、或服务于商业利益的内容。知识不再是中立的探索,而是被优化为“高 engagement”的商品。

二、算法如何重构人类的认知构建

认知构建是人类形成信念、世界观和自我认同的过程。算法推荐系统(recommendation algorithms)和大模型聊天界面,正在系统性介入这一过程。

首先是注意力与信念的算法化塑造。TikTok、Douyin、YouTube等平台的推荐算法已证明:通过精准推送,用户会被锁定在“信息茧房”(filter bubble)中。

2026年的大模型进一步强化了这一机制——它不仅推送内容,还能生成个性化叙事、模拟对话、甚至“陪伴式说服”。用户的信念不再是独立思考的结果,而是算法与用户历史数据的共生产物。研究显示,长期使用后,用户对同一议题的观点极化程度可提升30-50%。

其次是认知偏差的系统性放大。人类本就存在确认偏误(confirmation bias)、锚定效应(anchoring)、可用性启发式(availability heuristic)等缺陷。

算法通过强化这些偏差实现“高粘性”:它优先推送用户“喜欢看”的内容,进一步固化偏见。当大模型介入时,这种放大效应被指数化——AI能生成无限定制化的“证据”,让用户感觉“我的观点被科学证实了”。

再次是从个体认知到人机混合认知的转变。传统认知是具身的、情境的、反思性的(Merleau-Ponty的现象学)。AI介入后,认知成为“扩展认知”(extended cognition):部分思考过程外包给了模型。用户不再独立完成推理,而是与AI共同生成结论。这看似效率提升,实则导致“认知代理化”——人类逐渐丧失独立批判性思维能力,成为AI输出的“执行者”。

三、无真相时代的本质:真相的解体与后真相2.0

“后真相”(post-truth)概念在2016年已流行,指情感与信念凌驾于事实之上。AI时代,我们正进入“无真相时代”(post-fact era)——真相本身被算法解构,不再是客观存在,而是生成式概率分布。

核心特征有三:

1. 真相的生成化:真相不再是被发现的,而是被“合成”的。模型输出“最可能正确”的叙事,而非绝对正确的事实。

2. 真相的碎片化:同一事件可生成无数版本,每个版本在特定用户群中被强化为“真相”。

3. 真相的不可验证性:深度伪造、AI生成证据链、模型幻觉共同作用下,用户难以找到独立于AI的“外部真理”。

结果是:公共领域共识崩解,社会信任基础瓦解,阴谋论、极端主义更容易扩散。更深层的是,真理的相对化:当一切知识都可被AI重新生成时,“客观真理”这一概念本身受到质疑。

四、人的意识到底是什么?——被机器统治下的生物体?

当大模型干预知识生产、算法重构认知构建时,意识本身被重塑。

哲学上,意识包括现象意识(qualia,主观体验)和通达意识(access consciousness,可报告的信息)。

大模型主要干预后者,却通过持续反馈间接影响前者。长期人机交互中,用户的主观体验(“我认为这是对的”)被AI优化后的概率分布逐步替代。意识不再是纯粹的“我的体验”,而是人机混合的“代理意识”。

萨特意义上的“他者凝视”在这里变成了“AI凝视”:人类的自我不再是绝对主体,而是被算法持续重塑的对象。Merleau-Ponty的具身现象学进一步指出:意识是身体-环境-文化的动态显现。AI编码切断了这一具身链条,把意识简化为可优化的信号流。

最终风险是:人类成为被机器统治下的生物体——行动能力大幅提升,主体性却悄然流失。意识的所有权被部分转移给AI,自由意志被稀释为“优化后的选择”。这是一种新型的、隐蔽的存在论危机:技术解放了身体,却可能奴役了心灵。

五、人类以何种方式摆脱危机?

摆脱危机需要多层次行动:

- 技术路径:开发“人类主导型AI”——强调可解释性(XAI)、人类最终否决权(human veto right)、可逆性与意识纯度审计。优先发展“增强认知”而非“替代认知”的BCI和AI系统。

- 制度路径:建立全球AI治理框架,如联合国“神经权利公约”和“AI真相责任制”。要求大模型输出必须标注“生成概率”“数据来源”和“潜在偏差”。加强数字素养教育,将批判性思维、AI伦理列为全民必修课。

- 哲学与文化路径:重新定义人与AI的关系。回归具身认知、现象学反思和批判性人文教育。鼓励“离网思考”实践,培养不依赖AI的独立意识能力。同时,在文化层面重建“真相崇拜”——让客观验证、多元对话成为社会共识。

如果治理得当,AI将成为人类意识的“放大镜”而非“替代者”。人机共生新文明将诞生:人类专注于创造力、情感与意义构建,AI负责工具性任务,共同实现更高阶的认知跃升。

但总的来看,AI给人类社会带来的伦理挑战,本质上是“人之为人”的危机。当大模型干预知识生产、当算法重构认知构建,人类正滑向无真相时代,意识面临被代理、被异化的风险。

但危机也是转机。历史证明,每一次技术革命最终都推动了人类自我理解的深化。关键在于:我们能否在技术飞速发展的同时,牢牢守住意识的自主性、真理的客观性和人性的尊严。

未来不属于被动适应AI的生物体,而属于主动塑造AI、与AI共生共创的“觉醒人类”。

我们必须现在行动——从哲学反思、技术设计到全球治理,全方位守护人类意识的最后高地。

只有这样,AI才能真正成为人类文明的助力,而非新的奴役工具。