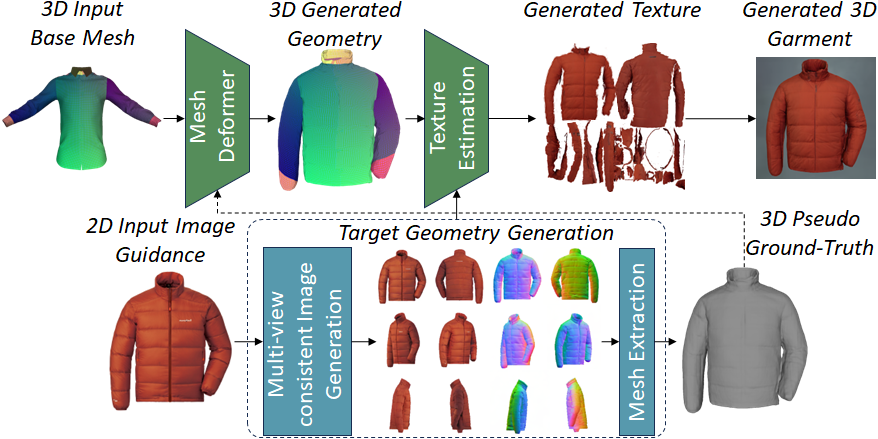

近日,Meta Reality Labs的科学家Nikolaos Sarafianos在其社交平台发布了一篇题为《Garment3DGen:3D服装风格化和纹理生成》的研究文章,里面展示了团队2D转3D的最新成果。

介绍指出,Garment3DGen是一个2D转3D模型,专门用于3D服装生成。

借助Garment3DGen,用户可以生成自己选择的纹理3D服装,而无需艺术家干预。人们可以提供文字提示来描述他们想要生成模拟就绪的3D资产的服装。我们对各种真实和生成的资产进行了大量的定量和定性比较,并提供了如何生成可用于模拟的3D服装的用例。

从展示的信息来看,基于Garment3DGen生成的3D服装具有出色的纹理以及细节信息,并且可以模拟真实服装的动态交互细节。

值得一提的是,其生成的3D模型还可以放置在参数化的身体之上以进行后续操作,如设计师可以基于此快速验证草图、将其应用于VR游戏应用场景等。